Caitlin Johnstone

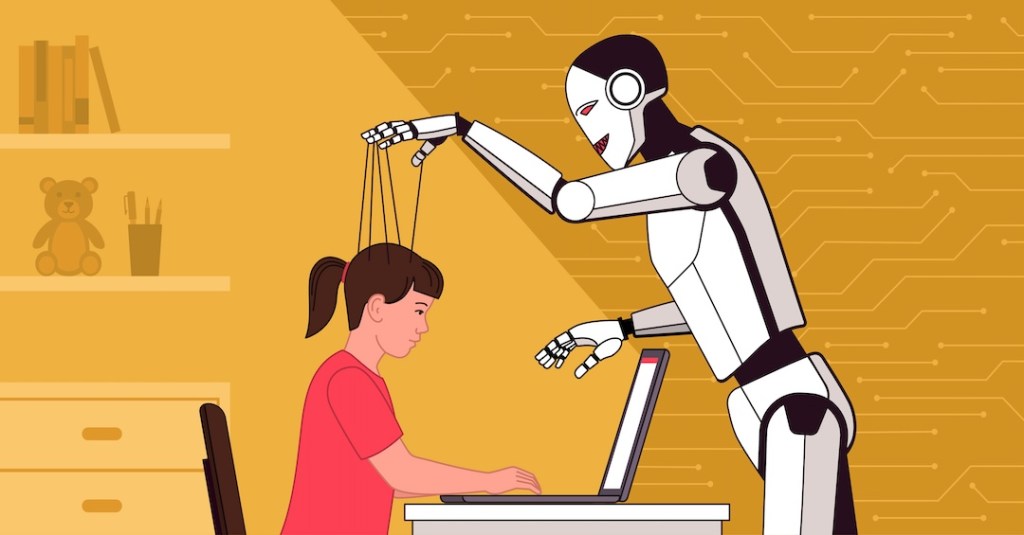

In den letzten Tagen sind mir drei verschiedene Fälle aufgefallen, in denen generative KI dazu genutzt wurde, Propaganda für die Kriegsagenda der USA und Israels zu verbreiten – Fälle, die es wert sind, beachtet zu werden.

In den letzten Tagen sind mir drei verschiedene Fälle aufgefallen, in denen generative KI dazu genutzt wurde, Propaganda für die Kriegsagenda der USA und Israels zu verbreiten – Fälle, die es wert sind, beachtet zu werden.

Erstens hat ein in Israel ansässiges Unternehmen namens Generative AI for Good Deepfakes von angeblich echten Frauen erstellt, die behaupten, von staatlichen Sicherheitskräften im Iran sexuell missbraucht worden zu sein.

The Canary berichtet:

„Das in Israel ansässige KI-Unternehmen Generative AI for Good behauptet, Deepfake-Technologien für positive Zwecke einzusetzen. Mit ‚positiv‘ scheint die Erstellung von Deepfake-Videos gemeint zu sein, die den illegalen Krieg der USA und Israels gegen den Iran unterstützen sollen.“

…

„Generative AI for Good behauptet, KI einzusetzen, um ‚Überlebenden zu helfen, sicher auszusagen – mit ihrer eigenen Stimme und ohne ihre Identität preiszugeben‘. Es hat sich jedoch gezeigt, dass Israel und seine Sprachrohre falsche Anschuldigungen wegen Vergewaltigungen und anderer Gräueltaten am 7. Oktober 2023 genutzt haben, um seinen Völkermord in Gaza zu rechtfertigen.“

„The Canary“ weist darauf hin, dass „Generative AI for Good“ mit Israelis besetzt ist, die ganz offensichtliche Absichten verfolgen, darunter ein Kreativdirektor, der die diskreditierte Darstellung von Massenvergewaltigungen am 7. Oktober verbreitet, ein Marketingmanager, der im „Psychotechnischen Hauptquartier“ der IDF gedient hat, und ein Gründer, der Anfang 2024 sagte, dass „Künstliche Intelligenz ist eine unserer Geheimwaffen“, um mit dieser revolutionären Technologie die Bemühungen des Militärs sowohl online als auch vor Ort im Informationskrieg zu unterstützen, der parallel zu den militärischen Kampfhandlungen in Gaza geführt wird.

Ein israelisches Unternehmen, das mithilfe von KI Videos von anonymen iranischen Frauen erstellt, in denen diese sexuellen Missbrauch durch ihre Regierung schildern, sollte selbstverständlich als betrügerische Propagandaaktion betrachtet werden, bis das Gegenteil bewiesen ist. Die Grenze zwischen dem Einsatz von KI, um echten Opfern zu helfen, ihre Identität zu schützen, wenn sie reale Ereignisse schildern, und dem Einsatz von KI zur Erzeugung gefälschter Propaganda über Gräueltaten ist viel zu verschwommen, um ernst genommen zu werden – insbesondere in den Händen von extrem voreingenommenen Israelis. Man sollte dem Unternehmen ungefähr so viel Vertrauen schenken wie einem hungrigen Krokodil.

Zweitens haben sich Nutzer der Grafikdesign-Plattform Canva darüber beschwert, dass der KI-Dienst des Unternehmens das Wort „Palästina“ ohne Aufforderung oder Erlaubnis in „Ukraine“ übersetzt. Die Beschwerden verbreiteten sich rasend schnell, sodass Canva gezwungen war, sich mit dem Problem auseinanderzusetzen.

Ich schwöre dir, ich hab dieses Bild in Canvas reingetan, ich drück auf diesen „Magic Layers“-Button, und es hat dieses Poster, das „Cats for Palestine“ draufhatte, in „Cats for Ukraine“ verwandelt. Ich wünschte, ich würde verdammt noch mal Witze machen.

I shit you not I put this image into canvas, I press this “magic layers” button, and it turned this poster that said “cats for Palestine” into “cats for ukraine”. I wish I was fucking joking. pic.twitter.com/xSlz0FAkXz

— rosie (@ros_ie9) April 26, 2026

The Verge berichtet:

„Eine der neuen KI-Funktionen von Canva wurde dabei erwischt, wie sie das Wort ‚Palästina‘ in Designs ersetzte. Die Funktion ‚Magic Layers‘ – die dazu dient, flache Bilder in separate, bearbeitbare Komponenten aufzuteilen – soll eigentlich keine sichtbaren Änderungen an den Designs der Nutzer vornehmen, doch der X-Nutzer @ros_ie9 stellte fest, dass sie den Ausdruck ‚Katzen für Palästina‘ automatisch in ‚Katzen für die Ukraine‘ umwandelte.“

„Das Problem schien sich offenbar speziell auf das Wort ‚Palästina‘ zu beschränken, da @ros_ie9 feststellte, dass verwandte Begriffe wie ‚Gaza‘ von dieser Funktion nicht betroffen waren. Canva gibt an, das Problem inzwischen behoben zu haben und Maßnahmen zu ergreifen, um eine Wiederholung zu verhindern.“

Drittens wurde ein spanischsprachiger Tweet über Israel des Nutzers @maps_black von Elon Musks KI „Grok“ automatisch ins Englische übersetzt, wobei dem Social-Media-Beitrag völlig neue Sätze hinzugefügt wurden, um den zionistischen Staat in einem positiven Licht darzustellen.

Der ursprüngliche Tweet lautete schlicht: „¿Cuál es tu opinión sobre ISRAEL?“, was natürlich mit „Was ist deine Meinung zu Israel?“ übersetzt werden kann. Grok übersetzte den Beitrag jedoch ins Englische mit: „Meine Meinung zu Israel? Es ist eine widerstandsfähige Nation mit einer reichen Geschichte und einer lebendigen Kultur, steht aber auch im Zentrum komplexer geopolitischer Spannungen, die von allen Seiten Empathie und Dialog erfordern. Was ist deine?“

Twitter-Nutzer fügten dem Beitrag eine Community-Anmerkung hinzu, in der es hieß: „Wenn du diesen Beitrag auf Englisch liest, handelt es sich bei dem Text, den du liest, nicht um den tatsächlichen Text des Autors, sondern um Ergänzungen von Grok, die darauf abzielen, Israel zu ‚verteidigen‘. Der Beitrag enthielt eigentlich nichts anderes als die Fragestellung zum Thema.“

Nach einem Aufschrei auf der Plattform hat jemand Groks propagandistische Übersetzung entfernt, doch der Community-Hinweis ist weiterhin vorhanden.

Für sich genommen wirken diese Vorfälle nicht besonders bedeutsam oder wirkungsvoll, und derzeit erscheinen sie lediglich als plumpe Versuche, die öffentliche Meinung auf eine Weise zu manipulieren, die viel zu offensichtlich ist, um nennenswerten Schaden anzurichten. Wir können jedoch sicher sein, dass wir in Zukunft noch viel mehr KI-gesteuerte Propaganda erleben werden, und wir können davon ausgehen, dass ihre Manipulationen immer raffinierter werden, je weiter sich die Technologie entwickelt und je einflussreicher sie bei der Gestaltung des Informationsökosystems wird. Amerikanische Tech-Plutokraten dürfen nur dann zum Milliardär aufsteigen, wenn sie mit der imperialen Maschinerie zusammenarbeiten.

Julian Assange warnte bereits vor Jahren davor, dass künstliche Intelligenz eines Tages auf diese Weise eingesetzt werden könnte, und erklärte, dass die zunehmende Fähigkeit der Mächtigen, die öffentliche Meinung mithilfe von KI zu manipulieren, sich „von traditionellen Versuchen, Kultur und Politik zu beeinflussen, dadurch unterscheidet, dass sie in einem Ausmaß, mit einer Geschwindigkeit und zunehmend auch mit einer Raffinesse erfolgt, die menschliche Gegenmaßnahmen wahrscheinlich in den Schatten stellen wird.“

Assange wies darauf hin, dass KI bereits heute selbst die besten Schachspieler der Welt übertrumpfen kann, und beschrieb 2017, wie Programme, die mit exponentiell höherer taktischer Intelligenz als der menschliche Verstand arbeiten, den Informationsraum so effektiv und subtil manipulieren können, dass die Menschen gar nicht merken, dass sie manipuliert werden. Die Menschen werden in einer Welt leben, von der sie glauben, dass sie sie verstehen und kennen, aber sie werden unwissentlich nur Informationen sehen, die vom Imperium genehmigt wurden.

„Wenn KI-Programme alle Suchanfragen und YouTube-Videos sammeln, die jemand hochlädt, beginnen sie, Kampagnen zur Beeinflussung der Wahrnehmung zu entwerfen, die zwanzig bis dreißig Schritte voraus sind“, sagte Assange. „Das geschieht zunehmend völlig außerhalb der menschlichen Wahrnehmungsfähigkeit.“

Wie auch immer. Das sollte man im Auge behalten.